Artigo

Deep Fake, A Mais Recente Ameaça Distópica

Deep Fake, a mais recente ameaça distópica

Estas pessoas não existem: são “criadas” por Inteligência Artificial. Fotos, vídeos e textos muito verossímeis multiplicam os riscos de manipulação total. Emerge imenso problema: como regular a ciência, em meio à crise civilizatória?

OUTRASPALAVRAS

Publicado 30/05/2019 às 19:34 - Atualizado 30/05/2019 às 19:47

Por Michael K. Spencer | Tradução: Gabriela Leite

Em 2019, vivemos em um mundo no qual vídeos e imagens deepfake de pessoas, totalmente fabricadas, podem ser criadas por inteligência artificial

Enquanto isso, uma tecnologia chamada GPT-2 da OpenAI está ficando famosa por sua habilidade de escrever convincentemente e enganosamente [reproduzindo o estilo de autores como George Orwell, ou o seu (N.T.)].

Nesse novo mundo, a IA é capaz de mimetizar conteúdo humano, e tem o potencial de ser usada por maus atores, e campanhas financiadas por Estados, para influenciar os sentimentos da população de várias formas.

Estamos testemunhando uma explosão de fraude online. Em uma era na qual até o Facebook recusa o título de empresa de mídia, o que exatamente são os deepfakes?

A invasão dos deepfakes

Deepfakes são, essencialmente, identidades falsas criadas com o deep learning [aprendizagem profunda, por meio de uso maciço de dados], por meio de uma técnica de síntese de imagem humana baseada na inteligência artificial. É usada para combinar e sobrepor imagens e vídeos preexistentes e transformá-los em imagens ou vídeos “originais”, utilizando a tecnologia de GAN (Generative Adversarial Network, ou rede geradora antagônica). Veja uma primeira explicação neste vídeo:

Essa combinação de vídeos existentes e “originais” resulta em vídeos falsos, que mostram uma ou algumas pessoas realizando ações ou fazendo coisas que nunca aconteceram na realidade. Em 2019, também estamos vendo uma explosão de faces fake, através das quais a IA é capaz de conjurar pessoas que não existem na realidade, e que têm um certo fator de fluência.

De maneira fascinante, o engenheiro de software da Nvidia, Philip Wang, criou um website demonstrando a potência da técnica GAN para gerar imagens de pessoas falsas. Você pode conferir neste endereço:.

O site gera imagens baseado em um novo método de StyleGAN, desenvolvido pela Nvidia, que torna possível treinar o sistema para construir imagens artificiais de alta qualidade, com resolução de até 1024×1024 pixels.

Se você atualizar o site continuamente, verá um exemplo dessas “faces fake”, através do qual humanos digitais e personas falsas poderiam se tornar robôs (bots) de internet, capazes de nos influenciar em diversas maneiras. Aqui está uma amostra desses rostos: thispernondoesnotexist (essas pessoas não existem na vida real).

Como você pode observar, não há nenhuma maneira de dizer que essas não são pessoas reais. Personagens e textos fake são os próximos fronts do debate em torno do deepfake, que está só começando e é ainda outra maneira com a qual a inteligência artificial pode ser aproveitada como máscara e alterar o sentimento coletivo através de truques digitais.

Tecnologias como o GPT-2 e os GANs vão se tornar cada vez mais inteligentes. A suposta interferência russa no ciclo eleitoral norte americano de 2016 é um despertar para muitos, mas provavelmente apenas o início. Humanos digitais, âncoras de jornais de inteligência artificial, personas virtuais — tudo é possível na nova internet. O mercado de farsa online já está maduro.

Meio caminho rumo à Matriz

Criar uma realidade deepfake é meio caminho andado à Matrix. Pense só no potencial de uso indevido da combinação de vídeos e identidades deepfake com as fake news.

O crescimento dos deepfakes poderia abrir um novo front na guerra desinformacional.

A infiltração deepfake seria relativamente barata e fácil de transformar em arma.

Se as imagens, notícias e vídeos gerados por AI alcançaram um nível no qual estão frequentemente indistinguíveis de fotografias e vídeos reais, e conteúdo humano, estamos no limiar de uma nova era de guerras de inteligência artificial.

Não ser capaz de dizer o que é real na internet já é fortemente problemático em uma era de redes sociais e Facebook, mas nas condições atuais só vai piorar. Considerando que os jovens gastam mais tempo online do que nunca, eles provavelmente se tornarão mais acostumados à AI a cada ano, o que pode gerar consequências inesperadas na sociedade.

Por que o deep learning aumenta as fake news

O perigo dos deepfakes representa um novo tipo de ameaça à cybersegurança, na qual o que pode ser feito está muito à frente de como combatê-lo. Essas redes geradoras antagônicas (GANs), desenvolvidas pelo Nvidia, poderiam ser facilmente classificadas como uma má utilização do deep learning, se tais corpos regulatórios existissem.

Pode ser que você tenha visto o vídeo deepfake abaixo no YouTube. Obama poderia ter dito isso, mas ele não disse.

Em 2019, não apenas sua identidade pode ser roubada, você pode ser enquadrado, difamado e ser vítima de farsantes com os vídeos deepfake, que podem ser difíceis de se provar falsos. Você pode sofrer golpes, fraudes e ficar vulnerável online, e o inimigo seria a inteligência artificial.

A facilidade de usar os deepfakes implica que um novo tipo de hipocrisia e de conteúdo ilusório online está chegando. Não se trata mais de fake news, mas de memes, spam e conteúdo feito cada vez menos por humanos, para o bem e para o mal.

Geradores de texto falso. Imagens falsas. Vídeos falsos. Clonagem de voz. Clonagem de personas. A combinação de tecnologia mais inteligente vai criar problemas humanos muito reais, que vão muito além das fake news e dos discursos de ódio, que o facebook será incapaz de conter.

Antes de morrer, serei capaz de clonar a mim mesmo em uma persona feita por inteligência artificial que retenha não apenas alguns de meus pensamentos mais profundos, mas meus padrões comportamentais. Poderei deixar essa persona para meus descendentes.

Entrando na toca do coelho virtual

Enquanto isso, a internet continuará a evoluir na interseção da IA, de uma maneira na qual o modo como os humanos fazem versões de si mesmos pode ser irreconhecível até para nós. Caminhamos rapidamente em direção a um mundo de implantes neuro e no qual estaremos cercados não apenas de robôs, mas de identidades de IA (chame-os como quiser).

A geração Z, grupo das pessoas que nasceram na última década do século XX e nos primeiros anos do século XXI, está passando tanto tempo na internet que sua realidade é mais repleta de eventos online do que face a face.

A desinformação vai aumentar de tal maneira que o facebook e os deepfakes vão gerar um mundo de eventos míticos de imersão, entretenimento e um capitalismo de vigilância que será profundamente perturbador para nossa saúde mental e estabilidade política.

Se regulação da IA atrasar, muitos perigos surgirão, devido aos desenvolvimentos tecnológicos e os usos de novas ferramentas.

Fonte:

https://outraspalavras.net/tecnologiaemdisputa/deep-fake-a-ultima-distopia/

O que é Deep Fake e porque você deveria se preocupar

Tecnologia usada para colocar o rosto de uma pessoa em outra em um vídeo, o Deep Fake está tirando o sono de todo mundo

Por Ronaldo Gogoni

Por Ronaldo Gogoni

TB Responde

Uma ferramenta de edição de vídeos criada por um usuário do Reddit tem sido uma tremenda fonte de dores de cabeça para celebridades, pessoas públicas e companhias de entretenimento. O Deep Fake usa Inteligência Artificial para trocar o rosto de pessoas em vídeos, com direito a sincronização de movimentos labiais, expressões e tudo o mais, em alguns casos com resultados impressionantes e bem convincentes.

No entanto, ninguém está a salvo de ter seu rosto incluído em um vídeo editado.

O que é Deep Fake?

A onda de trocar rostos de pessoas em vídeos não é nova. Mas, em dezembro de 2017, um usuário do Reddit, chamado deepfakes, deu um passo além. Com ferramentas de Inteligência Artificial e Aprendizado de Máquina de código aberto, como Keras e TensorFlow (este último, do Google), ele criou um algoritmo para treinar uma Rede Neural a mapear o rosto de uma pessoa no corpo de outra, frame por frame.

Ao invés de depender de edição manual como antigamente, o usuário, através da ferramenta (que recebeu o nome de Deep Fake), precisa apenas de uma fonte para reconhecer o modelo do rosto da "vítima", mapear a estrutura da cabeça-destino e fazer a sobreposição. O software é capaz de ajustar a movimentação do vídeo original ao novo rosto e isso inclui expressões faciais e inclui os movimentos labiais.

No início, o Deep Fake exigia conhecimentos avançados por parte do usuário, mas quando outros criaram apps capazes de automatizar todo o processo, a ferramenta foi massivamente usada para o mal: logo começaram a surgir dezenas de vídeos adultos editados com o software, "estrelados" por atrizes e artistas como Gal Gadot, Taylor Swift, Selena Gomez, Ariana Grande, Emma Watson, Maisie Williams, Scarlett Johansson, Daisy Ridley e etc. Nomes que, obviamente, não fazem filmes deste teor/gênero.

Como a qualidade média dos vídeos não é muito alta, dadas as exigências de hardware (é preciso no mínimo uma GeForce GTX 1050 para resultados aceitáveis), tais criações chegam a ser bem convincentes a um desavisado, que pensará se tratar de um vídeo real, ainda que eles possuam uma falha: os protagonistas quase não piscam os olhos.

A "brincadeira" do Deep Fake não se limitou a vídeos adultos, no entanto: há uma série de criações que colocam rostos de celebridades em filmes nos quais não estiveram presentes, como que o alvo é o ator Nicolas Cage. Entretanto, as possibilidades de uso do software são inúmeras e necessário dizer, nocivas.

Até Mark Zuckerberg foi alvo de um vídeo falso em que dizia: “imagine isso por um segundo: um homem, com controle total de bilhões de dados roubados, todos os seus segredos, suas vidas, seu futuro. Eu devo tudo isso à Spectre. A Spectre me mostrou que quem controla os dados controla o futuro”.

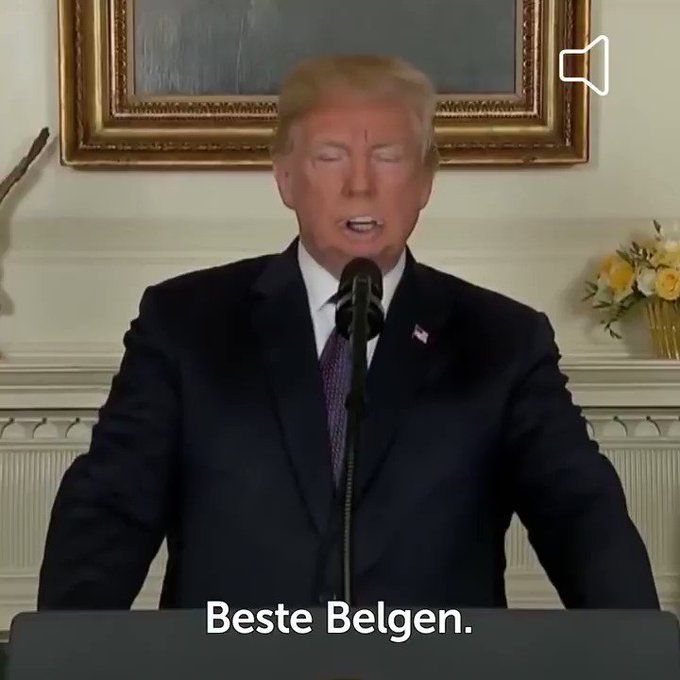

Spectre é o nome de um trabalho artístico que tenta chamar atenção para o risco de manipulação de pessoas por meio das redes sociais. Foram feitos deepfakes de políticos como Donald Trump, além de artistas como Morgan Freeman e Kim Kardashian.

Como o Deep Fake pode me afetar?

De várias formas. Ainda que o alvo principal da comunidade em torno da ferramenta sejam pessoas públicas, nada impede que alguém realmente mal intencionado pegue um vídeo de uma pessoa comum e o coloque em uma situação constrangedora.

Não pense apenas em vídeos de porn revenge editados: é possível, por exemplo, forjar um momento de descontração entre amigos para criar um álibi, um depoimento para convencer outros de que você defende um determinado ponto de vista ou mesmo uma situação de crime, de modo a incriminá-lo. Tudo depende da criatividade do editor e de quantos vídeos seus existem, que estejam disponíveis facilmente na internet.

O Deep Fake, inclusive, já foi utilizado na política: o partido belga Socialistische Partij, anders (Partido Socialista, mas diferente) criou um vídeo falso em que Donald Trump, presidente dos Estados Unidos, pede à população do país que votasse pela renúncia ao Acordo de Paris, um tratado que rege políticas climáticas.

O partido defende a criação de mais legislações ambientais e o vídeo falso com Trump foi uma jogada de Psicologia Reversa: se ele é contra leis a favor da natureza, a maioria do público acabaria votando a favor apenas para contrariá-lo.

Trump heeft een boodschap voor alle Belgen... #Klimaatpetitie

Informações e privacidade no Twitter Ads

85 pessoas estão falando sobre isso

Claro que vendo assim é fácil ver que se trata de uma edição, mas imagine o usuário em pé, dentro do metrô vendo esse tweet em um smartphone mais barato ou recebendo o vídeo pelo WhatsApp ou Telegram.

Com partidos políticos propensos a apelar para o Deep Fake, de modo a prejudicar um desafeto, para gente maldosa utilizá-la contra cidadãos comuns é um pulo inevitável.

Como foi a reação contra o Deep Fake?

A internet e a indústria do entretenimento em geral declararam guerra contra a ferramenta, que vem sendo tratada como Pornografia de Vingança: sob esse ponto de vista, os usuários que criam os vídeos falsos e os que os compartilham estariam cometendo um crime, visto que o ato já é tratado como tal em muitos lugares, inclusive no Brasil.

Não demorou muito e diversas plataformas, do Reddit (que atomizou a redditoria inteira) ao Twitter, passando por Discord, Gfycat, Pornhub e vários outros começaram a deletar vídeos e postagens relacionadas ao software, fossem os materiais de cunho adulto ou não. Além do ato de constrangimento, tais produções são protegidas por direitos autorais e uma das principais preocupações das plataformas é evitar processos.

E eles não devem demorar a chegar: o Sindicato dos Atores de Hollywood afirma que irá defender os direitos de seus representados, inclusive legalmente contra o Deep Fake. Há, inclusive, movimentos para forçar os responsáveis pelos vídeos a responderem criminalmente, em casos de produções adultas ou que envolvam material adulto junto.

O que posso fazer para me proteger?

O mais sensato a fazer é evitar o compartilhamento de vídeos pessoais com gente que você não conhece ou não hospedá-los em redes sociais de forma pública para dificultar o trabalho do editor, em pegar seu rosto e colocá-lo em outro vídeo mais comprometedor.

No geral, a sociedade ainda está se ajustando ao Deep Fake por se tratar de uma tecnologia nova e, se mal utilizada, extremamente prejudicial. É esperado que novos mecanismos jurídicos sejam aprovados de modo a combater a prática e proteger as pessoas. Portanto, caso você tenha sido vítima, colete todas as informações necessárias e procure um advogado ou a Defensoria Pública assim que possível.

Fonte:

https://tecnoblog.net/264153/o-que-e-deep-fake-e-porque-voce-deveria-se-preocupar-com-isso/