Blog

-

Câmara aprova projeto que proíbe uso de animais em testes de cosméticos

Proibição também vale para produtos de higiene pessoal e perfumes; texto segue para sanção presidencial

-

Impacto da Inteligência Artificial no Pensamento Crítico

Impacto da Inteligência Artificial no Pensamento Crítico

-

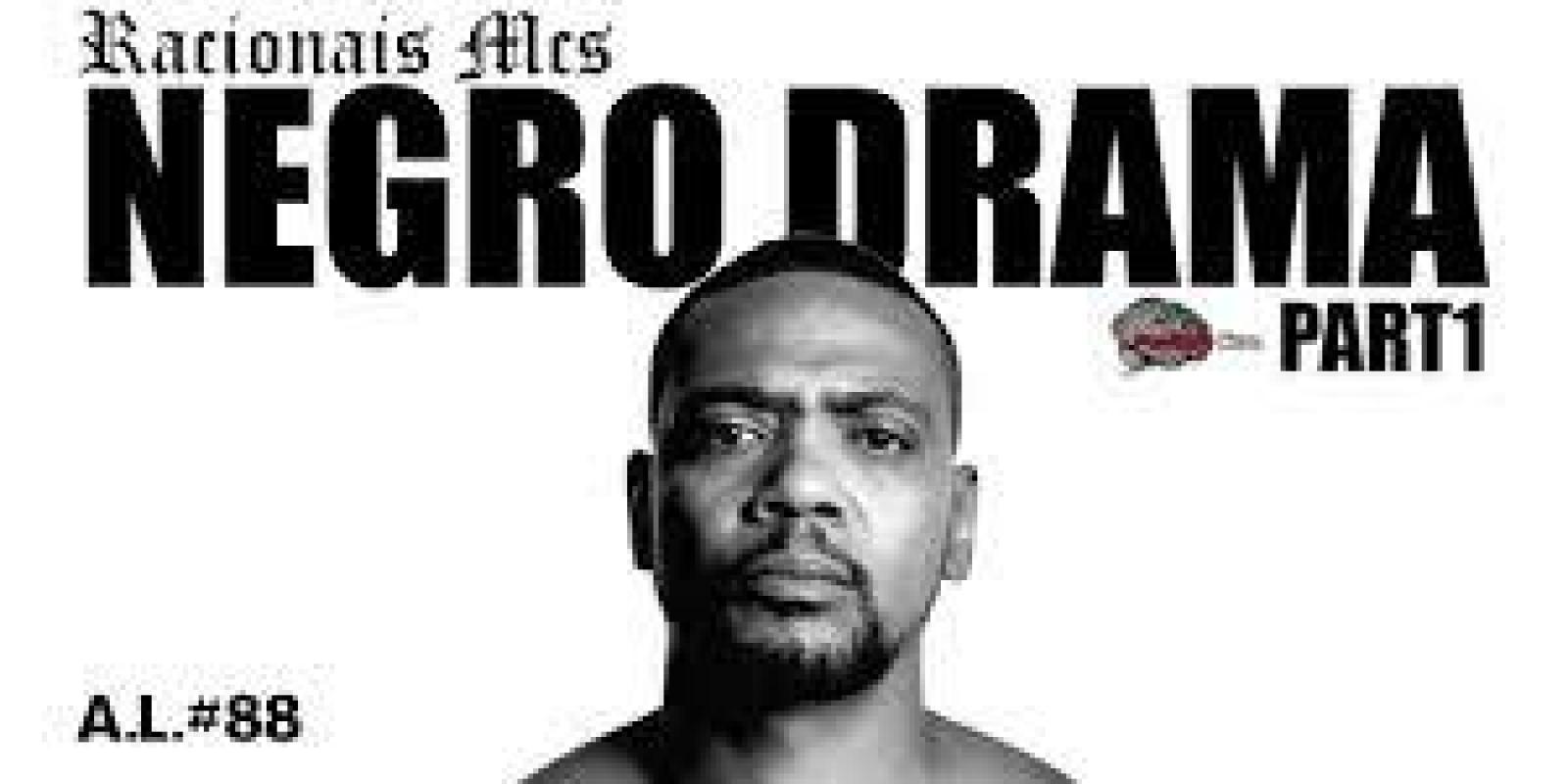

"Negro Drama", dos Racionais MC’s, é presente nas obras de Carolina Maria de Jesus e Lima Barreto

Com base na análise dos diários do escritor carioca e da escritora mineira e dialogando com a música dos Racionais MC’s, pesquisadora da Faculdade de Filosofia, Letras e Ciências Humanas (FFLCH) da USP estudou a experiência do negro drama na literatura